Mejorando la Seguridad de la IA: Uso de los Filtros de Contenido de Azure OpenAI para Prevenir el Jailbreaking

Rodrigo Juarez

Rodrigo Juarez

En el mundo actual impulsado por la inteligencia artificial, es fundamental proteger nuestros modelos del "jailbreaking", donde los usuarios intentan engañar a la IA para que se comporte de manera inapropiada. Azure OpenAI Service ofrece herramientas de filtrado de contenido robustas para abordar este problema de frente.

¿Qué es el Jailbreaking?

El jailbreaking ocurre cuando alguien crea entradas diseñadas para explotar vulnerabilidades de la IA, llevando al modelo a actuar fuera de sus directrices previstas. Esto puede resultar en que la IA genere contenido inapropiado o dañino.

Mecanismos de Defensa de Azure

Azure OpenAI Service proporciona varias características para combatir estos riesgos:

Escudos de Solicitudes: Estos detectan y bloquean entradas de usuarios maliciosas diseñadas para eludir las medidas de seguridad, previniendo eficazmente tanto ataques de inyección de solicitudes directos como indirectos.

Detección de Material Protegido: Esta función identifica y restringe la salida de contenido sensible conocido, asegurando que las respuestas de la IA sean apropiadas.

Filtros de Contenido Personalizables: Los usuarios pueden adaptar los filtros a las necesidades específicas de la aplicación, ajustando los niveles de severidad en categorías como odio, contenido sexual, violencia y autolesiones.

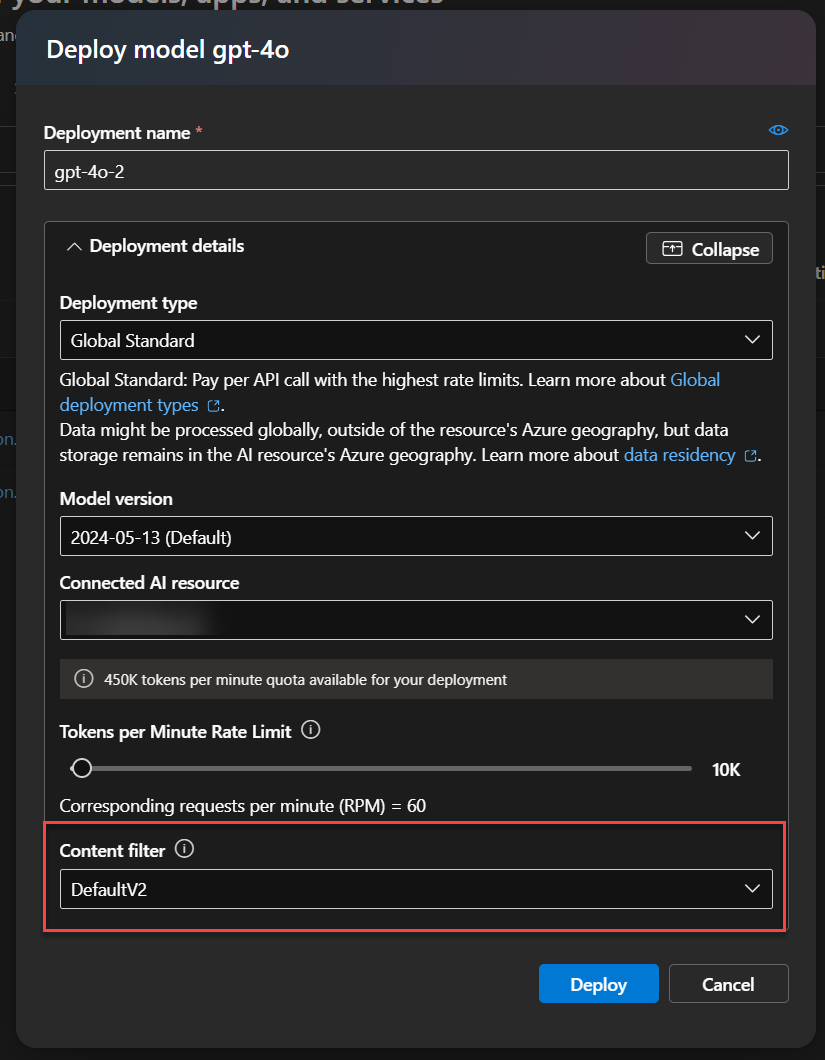

Configuración de Filtros de Contenido en Azure OpenAI

Para aplicar un filtro de contenido a un modelo desplegado en Azure OpenAI, sigue estos pasos:

Accede a Azure AI Studio y navega a la pestaña "Deployments".

Selecciona el despliegue al que deseas aplicar el filtro y haz clic en "Customize".

En la ventana de despliegue, selecciona el filtro de contenido deseado en el menú desplegable "Content filter".

Haz clic en "Deploy" para aplicar la configuración.

A continuación, se muestra una captura de pantalla ilustrativa de este proceso:

Al aprovechar estas herramientas, los desarrolladores pueden mejorar la seguridad y la integridad de los despliegues de IA, asegurando interacciones responsables y seguras con la inteligencia artificial.Referencias

Referencias

Azure OpenAI Service content filtering - Azure OpenAI | Microsoft Learn

Subscribe to my newsletter

Read articles from Rodrigo Juarez directly inside your inbox. Subscribe to the newsletter, and don't miss out.

Written by