QwQ-32B:重新定義開源推理模型的強大效能

KS Mooi

KS Mooi

在不斷發展的人工智慧領域中,阿里雲最近推出的 QwQ-32B 模型是一個重要的里程碑。儘管僅擁有320億個參數,這個創新的大型語言模型(LLM)表現卻相當出色,甚至超越了像 DeepSeek-R1 這樣擁有驚人6710億參數的巨型模型。

效能與強大的完美結合

QwQ-32B 最大的特點之一是其卓越的效能。相較於其他需要大量計算資源的模型,QwQ-32B 能以較少的硬體需求實現頂尖的效能。這種效率使其特別適合本地部署,能夠達到與 DeepSeek-R1 相同的便捷性和效果。

QwQ-32B 的創新特色

先進的推理與問題解決能力:專為複雜推理任務而設計,QwQ-32B 擅長將複雜問題逐步拆解,適用於研究、數學和策略規劃等領域。

卓越的程式編寫能力:能夠流暢地生成與調試多種程式語言的代碼,顯著協助開發人員簡化工作流程。

多語言支援能力:流利使用超過20種語言,包括泰語、越南語等資源較少的語言,擴大其全球適用性。

廣泛的上下文視窗:支援131,072個token的上下文視窗,能從大量文本中保持連貫性,對於理解綜合文檔至關重要。

透明的推理過程:獨特地展示其內部推理流程,提高使用者對AI決策的信任與理解。

工具呼叫與JSON整合:支持與外部工具互動及結構化資料交換,擴大了模型的整合可能性。

實際應用

QwQ-32B 的多功能性在現實場景中得到充分體現,例如:

衝突解決:生成均衡的解決方案與策略。

精準廣告投放:製作有吸引力且客製化的廣告內容。

商業策略規劃:制定精確的行動計畫與分析框架。

數據分析:進行詳細的計算並提供深入分析。

架構與訓練的卓越性

QwQ-32B 採用 Qwen2.5 架構,利用 RoPE 位置嵌入、SwiGLU 激活函數、RMSNorm 標準化及精密的注意力機制。此外,透過兩階段的強化學習(RL)訓練—專注於數學準確性、程式編寫能力以及整體人類偏好的對齊—使其成為領先的推理模型。

超越規模的性能指標

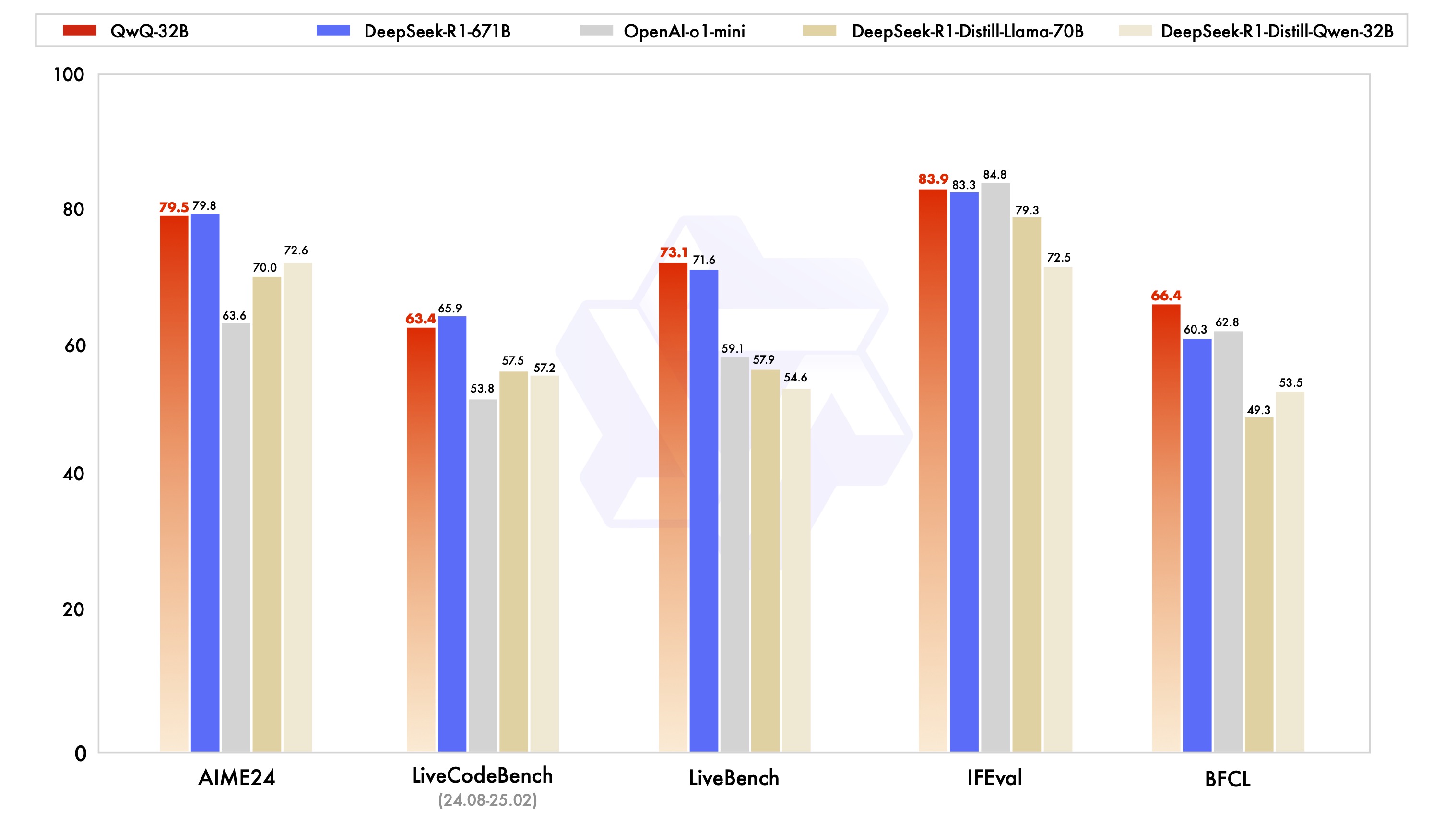

值得注意的是,QwQ-32B 不僅能與更大型的模型抗衡,甚至在重要基準測試如 LiveBench 和 IFEval 上更勝一籌,直接挑戰了「模型越大越好」的傳統觀念。

簡易本地部署

透過 Ollama、LM Studio 和 Hugging Face Transformers 等工具,QwQ-32B 的本地部署變得極為簡便。尤其透過 Ollama 直觀的介面,無論開發人員、研究團隊還是各規模的企業,都能輕鬆使用先進 AI 技術。

總結

儘管模型仍存在偶爾語言混雜及推理遞迴等限制,持續的微調與客製化有望帶來持續的改進。類似 QwQ-32B 這樣緊湊、高效且強大的推理模型,前景廣闊,將重新塑造人工智慧的格局。

QwQ-32B 是當今最佳的開源推理 LLM 之一,以其強大的性能和高效性超越許多大型模型。其先進的推理能力、便捷的本地部署及開源特性,使其成為推動 AI 技術普及的先鋒,為更多人提供了強大的 AI 解決方案。

Subscribe to my newsletter

Read articles from KS Mooi directly inside your inbox. Subscribe to the newsletter, and don't miss out.

Written by

KS Mooi

KS Mooi

AI Enthusiast Exploring the forefront of AI with a focus on deep learning, reinforcement learning, and agentic AI. Passionate about creating intelligent, adaptive models and applying retrieval-augmented generation (RAG) techniques to push the boundaries of what's possible in real-world applications.